L'IA générative : facteur aggravant de la fracture numérique ?

Maîtriser l'IA lorsqu'on a déjà du mal à utiliser le numérique... à l'heure où l'intelligence artificielle s'imisce dans tous les aspects du quotidien, une double peine se profile pour les personnes mal à l'aise avec l'informatique ou en situation de précarité. Dans ces conditions, comment faire pour que l'IA profite vraiment à tous⸱tes ?

Par Elise Pottier

14 avril 2026

Selon l’enquête menée en 2021 par l’Insee (Institut national de la statistique et des études économiques, organisme qui collecte, produit, analyse et diffuse des informations sur l’économie et la société françaises), 15 % de la population française se trouve en situation d’illectronisme. Cette notion désigne le fait qu’une personne ne possède pas les compétences numériques de base (rechercher des informations et communiquer en ligne, utiliser des logiciels, protéger sa vie privée, résoudre des problèmes), ne sache pas ou ne puisse pas utiliser Internet.

Or, pour utiliser correctement les IA génératives qui ont envahi notre paysage, ces compétences numériques sont indispensables. ChatGPT, Claude, Gemini et consorts nécessitent en effet la saisie de prompts bien construits et détaillés pour générer un résultat cohérent et pertinent. Ce terme désigne les instructions données à l’IA pour obtenir ce que l'on attend d’elle (par exemple : "trouve-moi une recette de tartiflette pour 4 personnes, sachant que l'une d'elles ne mange pas de viande").

Demandez à une personne qui rencontre des difficultés informatiques ce qu’est un prompt : il y a fort à parier qu’elle ne le sache pas. Rien que le fait d’utiliser des termes anglais peut se révéler problématique, car les personnes défavorisées maîtrisent moins bien la langue de Shakespeare. En effet, selon une étude Ipsos réalisée en 2019, 4% seulement des personnes ayant un niveau d’études inférieur au bac pensent avoir un niveau d’anglais satisfaisant (contre 30% des personnes ayant un niveau scolaire supérieur au bac).

Une situation qui aggrave les inégalités : par exemple, de nombreux services publics intègrent des robots conversationnels, mais il n’est pas toujours facile de savoir quels termes utiliser pour échanger avec eux. Ces outils peuvent alors répondre de façon erronée aux demandes formulées. Quant au monde professionnel, il n’est pas en reste :

10 à 15 %

des entreprises avaient mis en place une solution comprenant l’IA dans leur gestion des recrutements fin 2025 en France

Source : CCI (Chambre de Commerce et d'Industrie)

Pour faire bonne impression face à ces nouveaux outils, mieux vaut en connaître les codes et le langage - ce qui n’est pas forcément évident pour des personnes en situation de précarité.

Par ailleurs, l’agent étant le nerf de la guerre, les versions payantes des outils d’IA permettent une utilisation plus complète que leur format gratuit. Le seuil de limite des échanges est plus important et la précision des réponses s’affine avec un abonnement payant. Or les publics défavorisés ne peuvent pas nécessairement se permettre d'investir dans une version optimisée de ces outils.

Les contenus produits par l’IA peuvent induire en erreur les personnes vulnérables

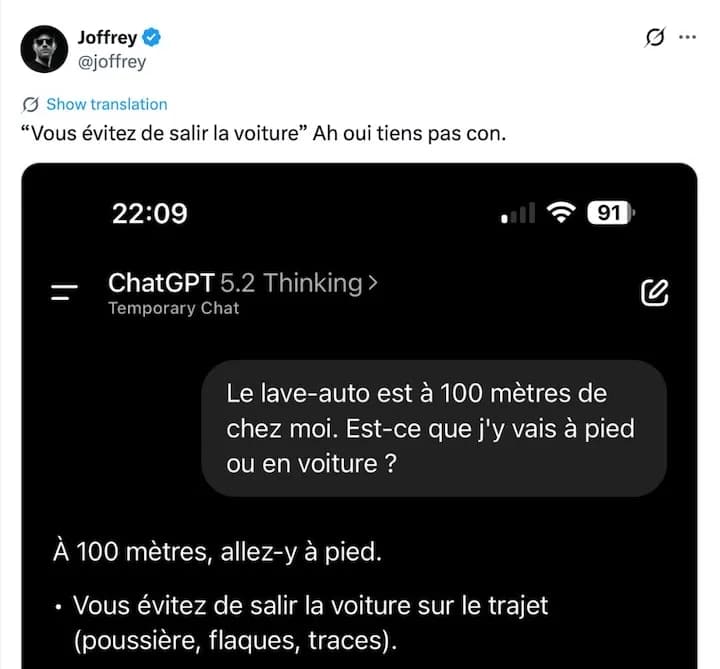

C'est un fait, bien connu depuis le lancement de l'IA générative auprès du grand public fin 2022 : l'intelligence artificielle a tendance à halluciner. Les hallucinations correspondent à des résultats incorrects ou trompeurs générés par les modèles d’IA. Certains de ces propos sont même devenus la risée d'Internet.

Certains cas sont si grossiers que personne ne peut s’y laisser prendre, mais d’autres sont plus subtils et peuvent réellement induire en erreur. Citons le cas de cet australien qui, début 2025, avait demandé à ChatGPT s’il fallait un visa pour aller au Chili. C’est effectivement le cas, mais l’IA lui a assuré que ce n’était pas nécessaire. Résultat : l’homme s’est retrouvé bloqué à l’aéroport et n’a pas pu entrer sur le territoire chilien.

Autre sujet de préoccupation : certaines personnes souffrant de problèmes physiques ou mentaux s’en remettent à l'IA pour se soigner. C’est d’autant plus vrai dans les déserts médicaux : ainsi, une étude d’OpenAI datant de fin 2025 révèle que les habitant·es des zones rurales américaines éloignées de tout hôpital (à plus de 30 minutes en voiture) envoient près de 580 000 messages liés à la santé par semaine sur ChatGPT. Les États les plus concernés (le Wyoming, l'Oregon et le Montana en tête) sont les moins peuplés et les plus isolés. Certaines personnes utilisent donc l’IA pour pallier un manque d’accès aux soins : l'intelligence artificielle devient alors une sorte de premier recours quand le·la docteur·e est trop loin. Or, du fait des hallucinations, celle-ci est susceptible de tenir des propos inadaptés, ce qui peut retarder la prise en charge des utilisateurs⸱rices par des professionnel⸱les de santé.

Enfin, les publics moins diplômés sont davantage susceptibles de voir leur confiance ébranlée par un deepfake, notamment s’il concerne un sujet politique, alors que les plus diplômés parviennent mieux à relativiser ou détecter la manipulation. Cette notion, anglophone elle aussi, désigne un hypertrucage : des images ou des enregistrements vidéo ou audio réalisés ou modifiés grâce à l’intelligence artificielle. Leur objectif est souvent la désinformation ou le cyberharcèlement, notamment sur les réseaux sociaux. Le manque de connaissances, d’éducation et la difficulté à distinguer le vrai du faux constituent des éléments déterminants face à la désinformation. À cela s’ajoute un mécanisme psychologique bien documenté : le biais de confirmation. Cela signifie que lorsqu'une fausse information correspond aux croyances déjà ancrées d’un individu, sa probabilité d’y adhérer augmente.

Les personnes en situation de précatité ne sont pas forcément plus naïves que les autres. En revanche, les outils pour se prémunir des fausses informations (esprit critique, éducation aux médias, accès à des sources fiables) sont inégalement distribués selon le niveau d’éducation et les ressources culturelles mises à la disposition des citoyen⸱nes.

Comment faire de l’IA un outil qui profite à tous⸱tes ?

Malgré tous les défis que l’IA pose à nos sociétés, des leviers existent - à condition de les activer collectivement :

- Former dès le plus jeune âge

La scolarité étant obligatoire jusqu’à 16 ans, l’école constitue le seul filet touchant l'ensemble des enfants et adolescent⸱es, quels que soient leur milieu ou leur territoire. Intégrer dans les programmes du collège une culture de l’IA (comprendre comment fonctionne un modèle génératif, apprendre à formuler un prompt précis, exercer son esprit critique face aux réponses produites) permettra de combler le retard que les enfants défavorisé·es prendraient sans cela.

- Former les adultes ayant quitté l’école

Les centres d’insertion, les maisons de quartier et les associations de proximité ont déjà joué ce rôle dans les années 2000, lors de la démocratisation d’Internet. Ce modèle peut être reproduit avec l’IA. C’est d’ailleurs déjà le cas dans certains centres communautaires, comme la Maison de quartier du Mario à Coudekerque-Branche, dans le département du Nord, qui a réuni en mars 2026 des adultes qui ont pu poser leurs questions, exprimer leurs interrogations et mieux comprendre les enjeux liés à l’utilisation de l’IA. Cette logique implique aussi de former en priorité ceux qui sont au contact quotidien des publics les plus fragiles, comme les médiateurs⸱rices numériques et les travailleurs⸱ses sociales⸱aux.

- Rendre les contenus IA clairs pour tous·tes

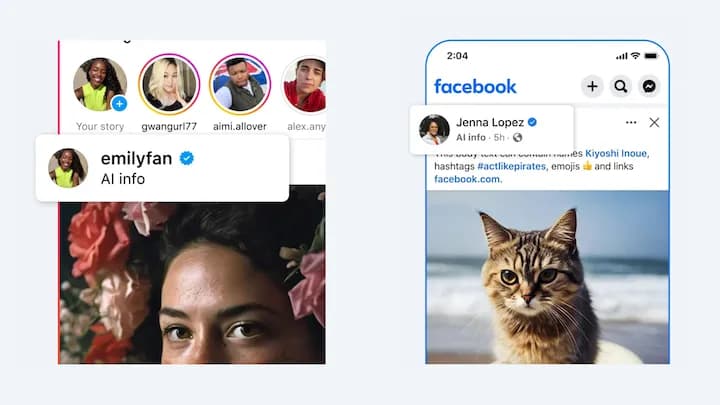

La pédagogie ne peut rien si les outils eux-mêmes restent opaques. Les plateformes doivent signaler de façon claire et bien visible les contenus générés par l’IA (textes, images, vidéos). Meta, TikTok et YouTube ont déjà sauté le pas en appliquant cette mention sur certains des contenus concernés. Une signalétique simple permettrait à chacun d’aborder les contenus avec le recul nécessaire, sans pour autant être un⸱e expert⸱e.

- Sensibiliser le grand public aux limites de l’IA

Les hallucinations des modèles et les biais qu’ils reproduisent restent encore peu connus de certains publics. Des campagnes de sensibilisation diffusées à la télévision, sur les réseaux sociaux ou sur les abris-bus pourraient normaliser des réflexes simples. Par exemple, vérifier une information produite par l’IA et ne pas prendre pour acquis ce qu’elle raconte. L'objectif étant que les citoyen⸱nes puissent développer leur esprit critique tout en prenant confiance en elles⸱eux.

- Penser un service public de l’IA.

Il s’agit sûrement là de la question la plus structurante, car laisser le sujet de l’IA aux seuls acteurs privés revient à accepter que ses bénéfices soient distribués selon la logique du marché, et donc de façon inégale. Une IA portée par des institutions publiques et conçue dans l’intérêt général ne résoudrait pas tout. Mais elle poserait des bases plus saines, car l’accès à ces outils est un droit - au-delà du pouvoir d’achat.

Ces pistes ne sont pas utopiques face à l’IA qui, tel un rouleau compresseur, progresse de plus en plus vite dans le paysage technologique actuel. Elles supposent une volonté sociale et politique claire pour faire face à l’arrivée de ces nouveaux outils qui aggravent les inégalités. L’objectif est simple : faire de l’IA un outil permettant à l'ensemble des citoyen⸱nes de tirer leur épingle du jeu.

Références :

Ipsos

Enquête sur le niveau d’anglais des FrançaisInsee

15 % de la population est en situation d’illectronisme en 2021Cese

Pour une intelligence artificielle au service de l’intérêt généralCCI

L’intelligence artificielle à l’ère du recrutement 2.0Vie publique

Jeunes de 15 à 30 ans : comment s’informent-ils sur les actualités ?National Library of Medicine

Pourquoi croyons-nous aux fake news ?Ouest France

ChatGPT lui donne une fausse information, il se retrouve bloqué à l’aéroport et rate sa conférenceNational Library of Medicine

False failures, real distrust: the impact of an infrastructure failure deepfake on government trustOpenAI

AI as a Healthcare AllyBIG Média

Utilisation de l’IA en soins de santé mentaleTikTok

Contenu généré par IAMeta

Identifier les contenus générés par l’IA sur Facebook, Instagram et ThreadsYouTube

Our approach to responsible AI innovation